Exploitez l'IA dès maintenant : guide complet

+ démo Eleven Labs et 🖼️ graphiques sur l'impact de l'IA en 2025

Hello à tous,

Bienvenue dans cette 58ᵉ édition ! Et aujourd’hui, j’essaye d’être votre boussole pour vous y retrouver dans la jungle de l’IA et répondre à 2 questions classiques :

Quel modèle IA choisir ?

Par où commencer pour exploiter les modèles ?

Vous pouvez cliquer sur le ❤️ au-dessus ou en fin de newsletter si vous appréciez le contenu, ça m’aide beaucoup ! 🙏

Voici le sommaire de la semaine :

💼 Tout savoir pour exploiter l’IA dès maintenant

🗞️ Mercato des cerveaux OpenAI <> Meta, Gemini CLI et levée de fonds de xAI

⚡ Démo de la nouvelle version vocale d’Eleven Labs

🖼️ 10 graphiques sur l’onde de choc de l’IA mi 2025

⏳ Temps de lecture : 10 min

Me retrouver ailleurs :

🧑💻 Mes réseaux : Linkedin, Youtube

🤚 Rejoindre la communauté IA (ressources, échange, support, ..) : sur Circle

📞 Des besoins en IA : Prendre RDV

📖 Se former sur l’IA : exploitez l’IA générative en entrepise ou automatisez votre création de contenu.

💼 Tout savoir pour exploiter l’IA dès maintenant

Depuis la sortie de chatGPT 3.5 en novembre 2022, l’interface a beaucoup évolué. On est passé d’une interface très brute, capable de générer du contenu depuis un prompt (qui nous était d’ailleurs suggéré) :

À un écosystème beaucoup plus complet, qui regorge de fonctionnalités pour booster la puissance des modèles bruts :

Dans cette logique, si on n’a pas pris le train en marche, on est un peu perdu… et c’est normal :)

L’objectif est alors de trouver l’écosystème le plus adapté à la plupart des utilisateurs.

Choisir le bon modèle pour vos tâches

Pour répondre à la question suivante : quel outil utiliser ? Claude, ChatGPT, Gemini… ou un autre modèle alternatif ?

Difficile d’y répondre sans connaitre vos objectifs et types de tâches que vous réalisez, la qualité, la rapidité ou la confidentialité que vous attendez.

Mais aujourd’hui il y a 4 écosystèmes à privilégier pour un usage sérieux : ChatGPT (OpenAI), Claude (Anthropic), Gemini (Google) et Mistral (FR).

Ils intègrent tous une interface soignée, une application mobile, un mode vocal, des fonctions multimodales (image, audio, documents), la possibilité d’exécuter du code, et des modèles de qualité.

ChatGPT (OpenAI) est le plus complet à date. Interface fluide, interactions multimodales puissantes, bonne gestion des fichiers, et des outils comme canvas ou la recherche approfondie (j’en parle plus bas) qui changent la manière de travailler. L’écosystème est cohérent, bien pensé, et évolue très vite (plus vite que les autres).

Claude (Anthropic) séduit beaucoup de personnes par la qualité rédactionnelle des réponses et un respect plus fort côté confidentialité. Mais, il manque pas mal de fonctionnalités (pas de génération d’image par exemple)

Gemini (Google) est un bon mix entre les deux : très fort en recherche et croisement d’infos (textes, web,…), la possibilité d’ajouter des vidéos en input est un gros point fort et sa fenêtre de contexte énorme. L’intégration dans l’écosystème Google est aussi intéressante.

Mistral (FR) mise sur des modèles ouverts (open-weights). Je l’ajoute surtout pour son aspect open source et français. Même si la performance des modèles est comparable à ceux plus haut, il manque de pas mal de fonctionnalités..

L’abonnement à 20 $/mois est souvent indispensable si vous voulez accéder aux fonctionnalités avancées. Vous pouvez commencer en version gratuite et souscrire quand vous êtes limités.

Pour les autres ?

Il y a aussi des alternatives (modèles ou agents spécialisés sur des tâches). Quelques repères :

Grok (xAI) peut séduire certains utilisateurs de X, mais perso, je ne le recommande pas : peu de transparence, génération parfois biaisée, et un cadre éthique limite…

Copilot (Microsoft) est souvent présenté comme une alternative, mais je le déconseille aussi : trop dépendant à l’environnement Windows, et une performance bien en dessous des autres modèles plus haut.

DeepSeek (Chine) proposent des modèles open-source puissants. Excellents sur le papier, mais pas d’interface fluide ou de service intégré clé-en-main.

Perplexity est l’outil le plus intéressant pour la recherche documentaire. C’est rapide, structuré, sourcé, avec une logique de “moteur de réponse”. Très bien mais uniquement sur la partie “recherche d’informations sur le web”

Manus, un agent web capable d’automatiser des tâches longues (collecte, tri, email, extraction de données). Un peu technique à prendre en main, mais bluffant quand bien configuré.

Zoom sur OpenAI : comment je choisis mes modèles dans ChatGPT

ChatGPT propose plusieurs modèles accessibles via le menu déroulant. Et là aussi, on peut vite se perdre.

J’utilise cet outil quotidiennement. Voici mon retour d’expérience, basé sur les usages concrets :

En bref, surtout le modèle 4o et o3. Mais aussi la fonctionnalité de recherche appronfondie (j’en parle juste après).

Pour la sécurité des données, peu importe votre choix, n’oubliez pas de désactiver l’utilisation de vos données pour entrainer les modèles. Rendez-vous en haut à droite dans : Profil > Paramètres > Gestion des données

Puis cliquez sur “Améliorer le modèle pour tous” et désactivez :

Le mode deep research : la recherche appronfondie sur-puissante

La recherche approfondie constitue une fonction clé de l’IA, et je trouve qu’elle est sous-utilisée par la majorité d’entre nous (en même temps, elle est un peu cachée).

Les solutions de Deep Research sont capables de produire des rapports de qualité ++. ça vaut la peine d’expérimenter ces rapports dans votre propre domaine pour mesurer le potentiel. Et c’est aussi super pertinent dans des cas plus personnels (comme organiser un voyage, avoir un avis complet sur un sujet, …)

Comme dans une utilisation classique des modèles, il peut y avoir des hallucinations mais les réponses sont bien plus fiables qu’une simple réponse générée à la volée, souvent parce qu’il y a des citations comme ici.

Ici, je vous partage un rapide schéma ce que réalise les modèles pour une recherche appronfondie (linkup peut être remplacé par chatGPT par exemple) :

Une utilisation accessible avec le mode vocal

Le moyen le plus simple pour se lancer, c’est de parler directement à l’appli mobile. Sur mobile, Gemini et ChatGPT gèrent ça très bien. J’ouvre l’app, je dicte en marchant ou en voiture, et ça suffit pour tester plein de choses.

À noter que sur le mode vocal, il n’y a pas de recherche sur le web, donc pour des informations factuelles, il peut raconter litérallement n’importe quoi.

Le vrai super-pouvoir : montrer ce que tu vois

Le plus bluffant, c’est le partage d’écran ou de caméra que j’utilise beaucoup côté perso, par exemple :

je prends en photo une plante en magasin pour savoir ce que c’est et si c’est adapté pour la saison

l’IA voit la même chose que moi et répond tout de suite

Créer des images, vidéos, code et autres fichiers

Les IA savent produire toutes sortes de contenus. ChatGPT, Gemini, Mistral peuvent générer des images sur simple demande. Claude ne peut pas encore le faire.

Dans l’ensemble, ChatGPT est le plus précis : on peut vraiment piloter la taille, le style, les détails.

J’ai tourné cette vidéo démo sur la génération avec OpenAI, si ça peut donner des idées. Vous verrez des cas classiques : créer un visuel marketing, illustrer un article de blog, etc

Pour la vidéo, Gemini se démarque avec veo 3 que vous avez peut être vu sur les réseaux sociaux.

Au-delà des images, les modèles sont capables de générer en format de sortie du code interactif, des graphiques, des interfaces (très puissant sur Claude), des documents (PDF, PPT, etc.)

Un exemple d’une interface générée sur Claude (et qui utilise claude en API) :

Mais attention sur la génération de documents, c’est un peu un point faible. Dès qu’on leur demande de formater, numéroter, insérer des tableaux dans des documents, ils hallucinent beaucoup. Bref, je déconseille de leur confier un rendu final en mode doc prêt à l’emploi. Mieux vaut récupérer le texte brut et le mettre en page à la main.

Mes conseils

Comme vous pouvez sûrement le voir, il y a pleins de choses à faire. On peut rester en mode chatbot sur une utilisation basique à un mode copilot surpuissant si vous la briefez correctement.

Je vous conseille de suivre ces étapes pour exploiter au maximum l’IA à chaque requête :

1️⃣ Choisir un modèle puissant → Par défaut, l’app lance un modèle rapide. Changez-le manuellement pour des tâches plus complexes.

2️⃣ Apportez du contexte → Ne partez pas d’une question vague. Donnez des infos concrètes, fichiers, exemples, besoins. C’est ça qui change tout.

3️⃣ Utiliser le mode voix + capture d’écran → Montrez ce que vous voyez : prendre un screenshot et le drag & drop à l’outil par exemple

4️⃣ Explorer la fonction Deep Research → pour générer des rapports complets, sourcés, actionnables : comparatif produit, veille concurrentielle…

5️⃣ Faire rebondir la conversation → modifiez vos prompts, testez des variantes, posez des contre-questions. Le secret est là.

Points d’attention

Les pièges courants quand on utilise l’IA, il y en a un paquet.

Déjà les hallucinations. Tous les modèles hallucinent, mais de moins de moins. Surtout s’ils vont sur le web, et si vous avez les citations. Restez vigilant !

Il n’y a pas de magie et les modèles n’ont pas de mémoire, ni n’apprennent pas en continu. Si l’IA réalise l’impossible avec peu de contexte, c’est souvent un coup de chance, un peu comme un oracle :)

Le modèle permet d’avoir une logique conversationnelle. Vous pouvez lui demander de vous poser des questions s’il n’a pas assez de contexte. Le vrai gain vient de l’usage, des A/R avec l’outil.

Plutôt que de demander pourquoi, vérifier l’information. Soit en regardant la chaine de pensée sur les modèles de raisonnement, soit en lui demander où il a trouvé l’information, d’où elle vient.

La prochaine étape pour vous ?

Vous avez maintenant la boîte à outils, reste à l’ouvrir ;)

Pour résumer, vous pouvez :

Choisir votre IA et prendre la version payante (la vraie puissance commence à 20 €)

Passez aussitôt à l’action.

Modèle avancé : donnez-lui un vrai challenge que vous avez au travail avec tous les fichiers utiles (docs, tableurs, graphiques). Demandez un livrable concret, mémo, code, schéma, puis faites-le affiner au max.

Deep Research : lancez-le sur une étude complète (type analyse concurrentielle)

Mode vocal en situation : je l’utilise pour brainstormer, pratiquer une langue et résoudre des pépins à la volée.

Explorez tout le reste comme la génération d’images (ex : visuels marketing) et la lecture de PDF/PowerPoint pour qu’il résume ou reformate. Testez ces briques dans vos projets pro et perso

La plupart débutent : question courte, zéro contexte, réglages par défaut. Vous avez les clés pour mieux faire : chargez vos documents, poussez-le à proposer 30 idées, dupliquez les conversations pour comparer, alternez texte, voix et image. La différence entre l’utilisateur lambda et un power-user, c’est pas la magie d’un prompt, c’est l’usage.

🗞️ 3 actus importantes

Meta mise sur la superintelligence et débauche les meilleurs talents d’OpenAI

Meta restructure en profondeur son pôle IA pour viser un objectif ambitieux : développer une superintelligence, une IA capable d’égaler ou surpasser les humains dans de nombreuses tâches. Pour y parvenir, Mark Zuckerberg a créé un labs, confié à Alexandr Wang, ex-CEO de Scale AI, et a lancé une offensive de recrutement sans précédent.

Meta aurait déjà attiré au moins 11 chercheurs venus d’OpenAI, Anthropic ou DeepMind. Pour convaincre ces profils rares, Meta mise sur des packages de plusieurs dizaines de millions de dollars et un accès à des moyens techniques hors norme (infrastructures, puces, données). En parallèle, Zuckerberg constitue une “liste confidentielle de chercheurs stars”, contactés personnellement, parfois même depuis ses résidences privées à Palo Alto ou Lake Tahoe.

Face à cette fuite de cerveaux, OpenAI tente de réagir : revalorisation des salaires, contre-offres et campagnes internes de rétention. Mais les chercheurs sont de plus en plus attirés par la promesse de pouvoir travailler sur des projets à très grande échelle, avec la liberté de tenter de réels bonds scientifiques.

Ce qu’il faut retenir : C’est un peu une guerre des talents. Meta se positionne clairement pour dominer l’ère de la superintelligence, quitte à affaiblir ses rivaux par un recrutement ciblé et agressif…

👉 Source TechCrunch

Google lance Gemini CLI, un assistant IA open-source pour le terminal

Comme OpenAI avec Codex, Anthropic avec Claude code, Google dévoile Gemini CLI, une interface en ligne de commande open-source qui intègre directement Gemini 2.5 Pro dans le terminal des développeurs.

C’est une grosse tendance qui émerge et fait gagner un temps énorme pour les développeurs. L’agent peut coder, déboguer et automatiser des tâches via des prompts en langage naturel, tout en s’appuyant sur le protocole MCP pour une extensibilité maximale. Le quota gratuit est généreux : 60 requêtes/minute et 1 000/jour, positionnant Gemini CLI comme une alternative sérieuse face aux solutions intégrées à des IDE ou Cursor.

Un exemple d’utilisation ici pour la réalisation d'une courte vidéo montrant l’aventure d'un chat autour de l'Australie avec Veo et Imagen (et l’aide de Gemini pour réaliser les actions)

👉 Source : Google Blog

xAI lève 10 milliards pour rivaliser avec OpenAI et Anthropic

La startup IA d’Elon Musk, xAI, vient de lever 10 milliards $.

Objectif : renforcer massivement ses capacités d’infrastructure et accélérer le développement de son assistant Grok, intégré à X.

Avec déjà 200 000 GPU installés dans son supercalculateur Colossus, et un objectif affiché d’un million de GPU, xAI ambitionne de bâtir l’un des plus grands data centers au monde. Cette levée valorise potentiellement xAI bien au-delà des 80 milliards atteints lors de l’acquisition de X.

Ce qu'il faut retenir : Face à OpenAI et Anthropic, la stratégie offensive de xAI renforce la course à l’infrastructure dans l’IA. L’ampleur des montants mobilisés confirme que l’accès aux puces et à l’énergie devient un facteur-clé de compétitivité.

👉 Source : CNBC

→ On se retrouve avec une explosion de l’investissement dans le secteur tech (surtout sur la partie infrastructure)

⚡ Démo de la nouvelle version vocale d’Eleven Labs

J’en parlais dans ma newsletter précédente, l'audio émotionnel arrive ElevenLabs v3 et ça va être un tournant pour les agents vocaux IA

Vous pouvez désormais moduler le ton, le rythme et les émotions de la voix comme un comédien, simplement via des balises comme [laughs], [whispers], etc.

👉 Applications concrètes :

Service client plus empathique

Ventes assistées plus nuancées

Compagnons vocaux pédagogiques ou rassurants

Disponible dans 70+ langues, ElevenLabs ouvre des usages puissants, de l'apprentissage des langues aux apps de santé mentale.

Je vous montre tout ça dans cette démo vidéo (y compris en français 👀) 👇

🖼️ 10 graphiques pour comprendre l’onde de choc de l’IA mi-2025

L’IA ne se contente plus de transformer nos outils. Elle redéfinit le pouvoir économique, les usages web, les rapports sociaux…

Et jusqu’aux revenus d’un pays du Pacifique grâce aux domaines en .ai 👀

Je tenais à vous partager quelques graphiques sur les changements de paradigme que l’IA apporte comme :

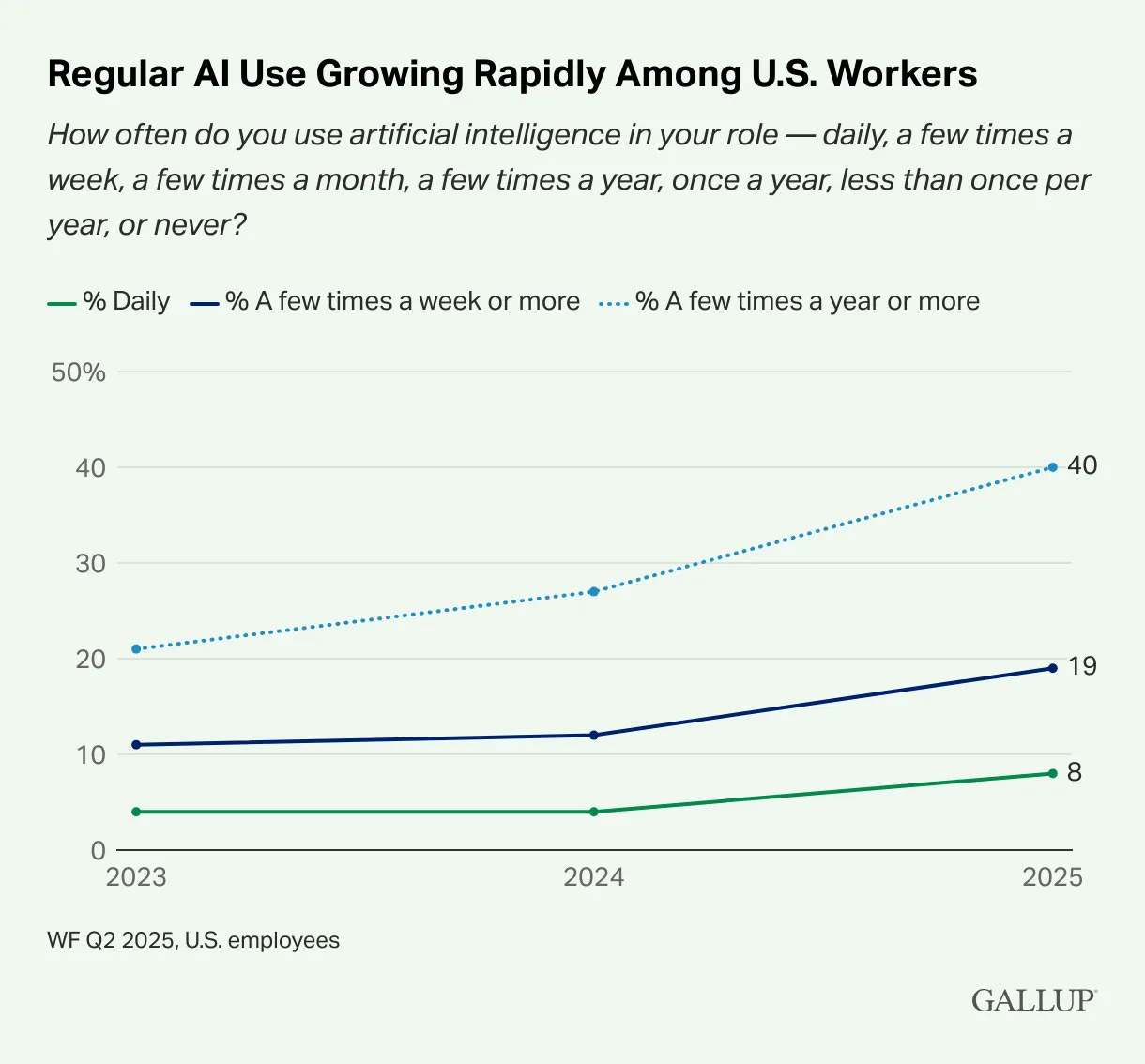

L’utilisation de l’IA en entreprise qui augmente fortement (surtout aux US)

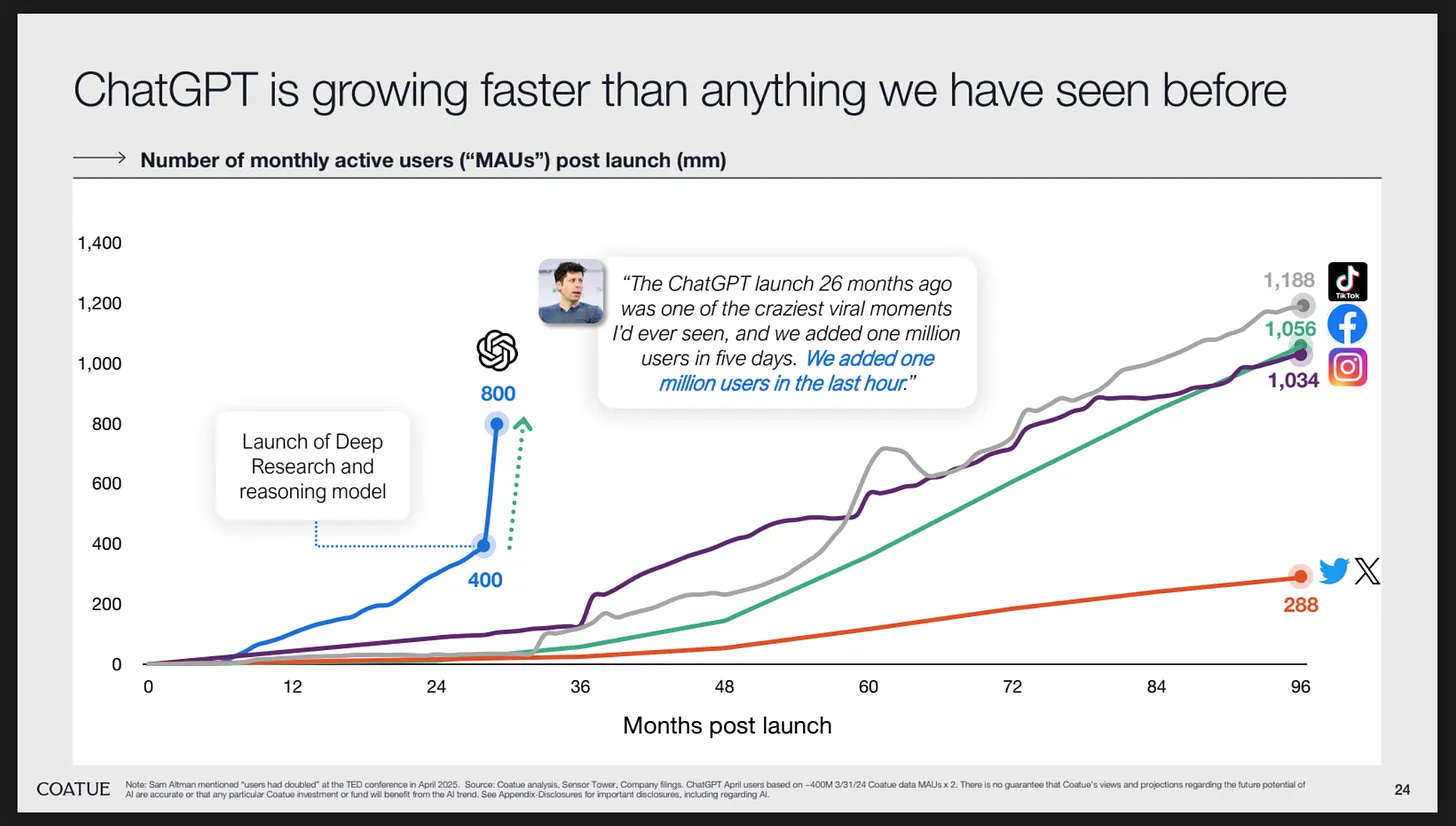

La grosse popularité de chatGPT

Les bots IA qui envahissent le web (j’en parlais dans ma dernière newsletter)

➡️ Les bots IA représentent déjà 2 % du trafic web

Le boom des domaines “.ai”

➡️ le .ai dépasse le .io en popularité (et en retombées économiques)

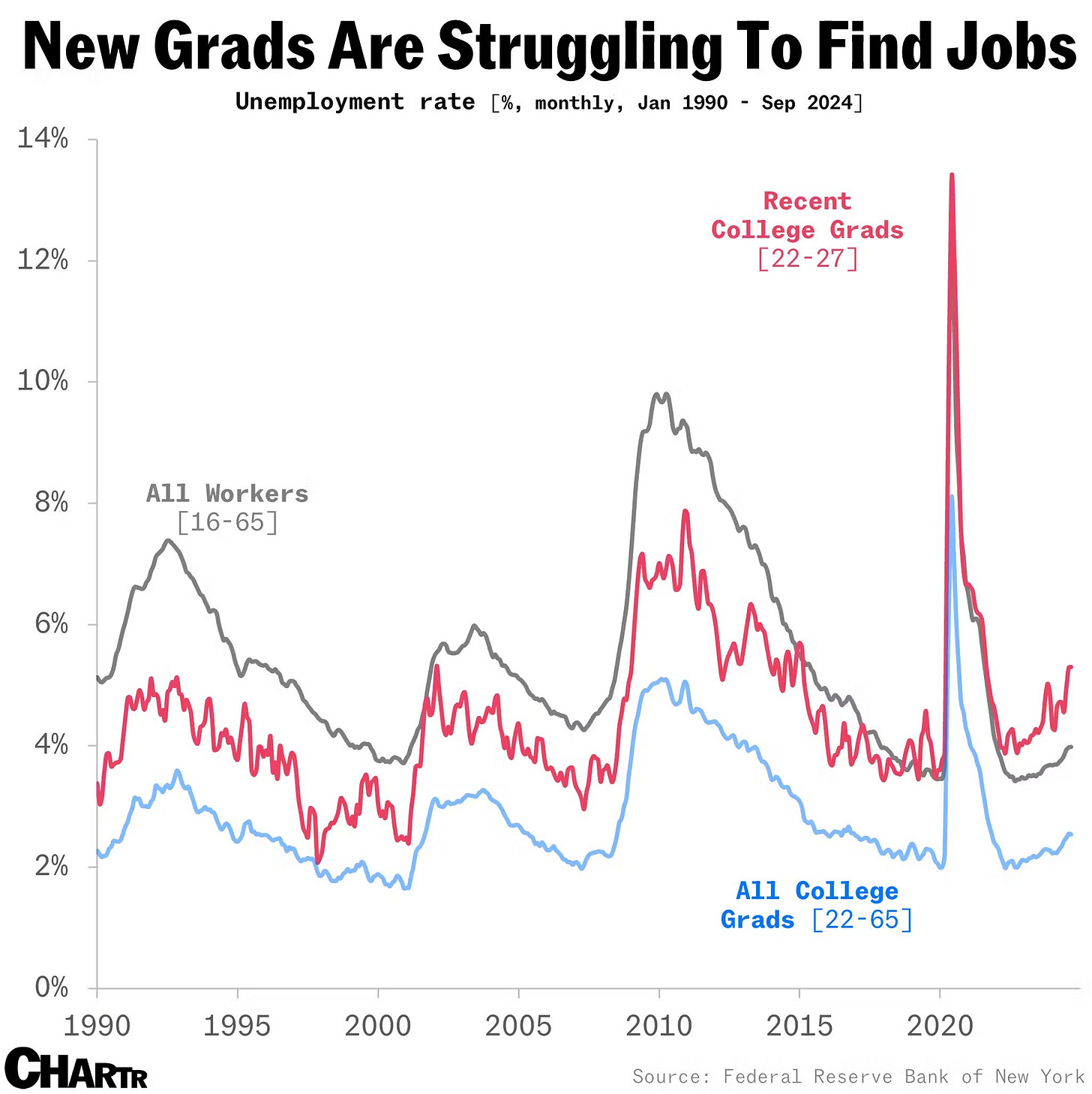

Plus de chômage chez les jeunes didiplômés

J’ai partagé tous ces visuels dans ce post LinkedIn

Merci 🫶🏼

D’avoir lu cette édition jusqu’au bout.

Si ça vous a plu, pensez à cliquer sur le ❤️ juste en dessous et partage ton point de vue en commentaire👇🏼

Vous pouvez aussi partager la newsletter à votre entourage (ça me booste beaucoup 🙏) et gagner des cadeaux 🎁

1 parrainage = 1 hack personnalisé

3 parrainages = +400 outils IA triés par thématique et vertical métier

5 parrainages = 30 min de coaching sur votre problématique

À très vite !

Merci pour tout ce travail, je viens de m’abonner à l’offre payante GPT5 et je lui ai demandé que pourrait être le programme politique en faveur du logement dans ma ma ville, avec de l’itération bien sûr. Epoustouflant. J’attends avec impatience tes 1er retours et hack. Ps: pour ton audience Orange propose à ses abonnés fixe ou mobile 50% sur l’offre payante de CHATGPT

merci beaucoup