Les Agents Vocaux IA : explication, exemples concrets et futur

+ ⚡ Des présentations avec Notebook LM

Hello à tous,

Bienvenue dans cette 69ᵉ édition ! Cette semaine, zoom complet sur les agents vocaux, une typologie d’agent qu’on déploie beaucoup en entreprise car l’impact est super intéressant en entreprise et la techno assez nouvelle.

On continue de recruter en stage de fin d’études et CDI avec Tandem, vous pouvez consulter l’offre ici. Si ça peut intéresser qqn dans votre entourage, n’hésitez pas à le partager.

Vous pouvez cliquer sur le ❤️ au-dessus ou en fin de newsletter si vous appréciez le contenu, ça m’aide beaucoup ! 🙏

Voici le sommaire de la semaine :

💼 Tout savoir sur les Agents Vocaux

🗞️ 3 actus importantes : OpenAI et son modèle d’image, Adoption de l’IA et évolution des modèles de vidéo

⚡ Faire des présentations avec Notebook

🏆 Top Meilleurs outils IA pour la vente

⏳ Temps de lecture : 13 min

Me retrouver ailleurs :

🧑💻 Mes réseaux : Linkedin, Youtube

📞 Des besoins en IA : Prendre RDV

💼 Les Agents Vocaux IA : explication, exemples et futur en entreprise

Sur la fin 2024, une tendance est devenu impossible à ignorer : les agents vocaux IA.

Vous l’avez peut-être remarqué aussi : de plus en plus de solutions vocales émergent, souvent verticalisées par métier (support, commercial, santé, immobilier…). Et ce n’est pas un hasard.

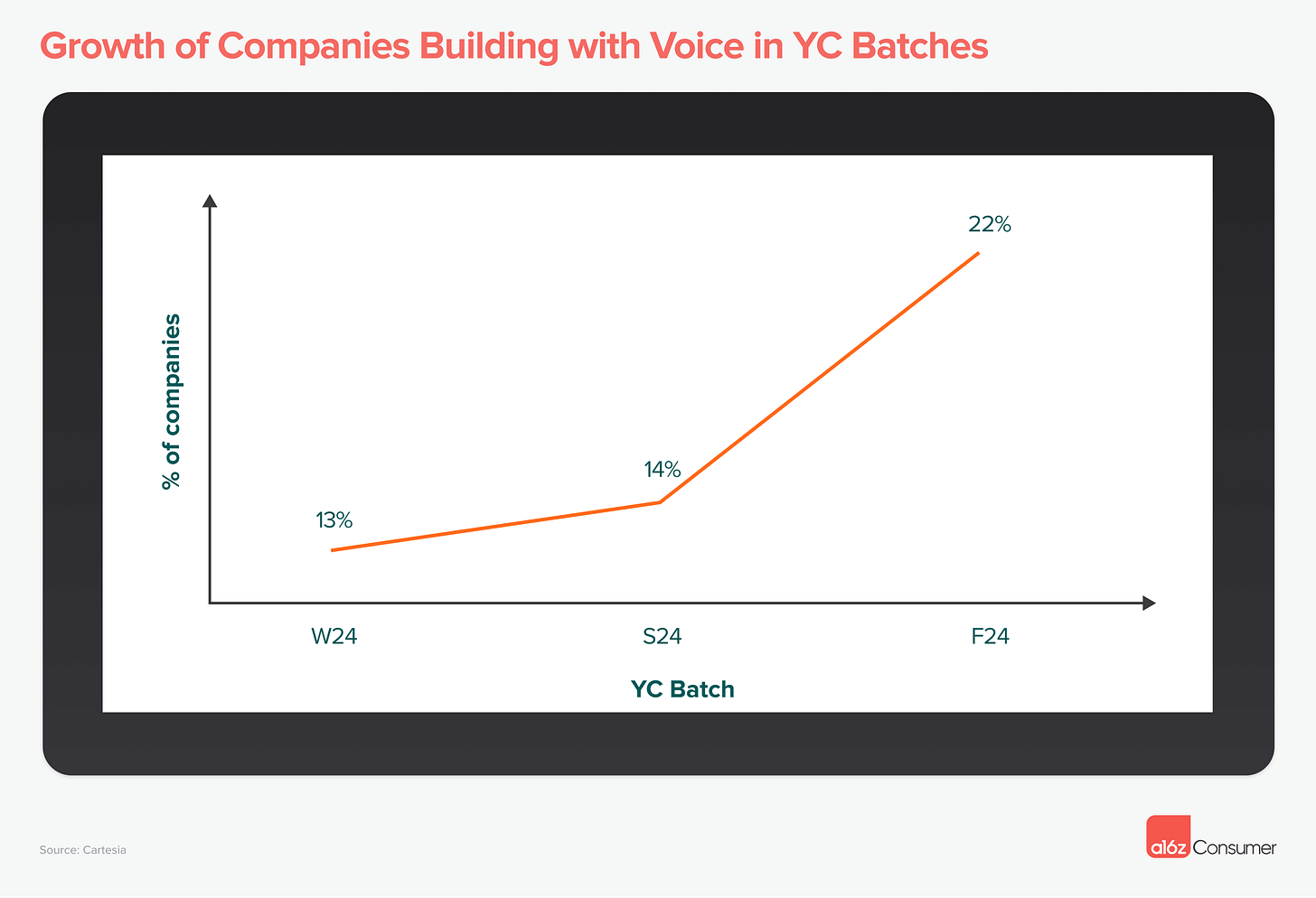

Y Combinator, l’un des plus grands incubateurs au monde voit sa cohorte d’automne 2024 avec 22 % des startups incubées travaillaient sur des agents vocaux. Presque 1/4.

Et sur 2025, on a pu voir ces entreprises se développer.

Même si on est encore au début, les agents vocaux commencent à s’intégrer dans les entreprises. Un peu comme les chatbots en 2020… mais avec une maturité technologique bien supérieure.

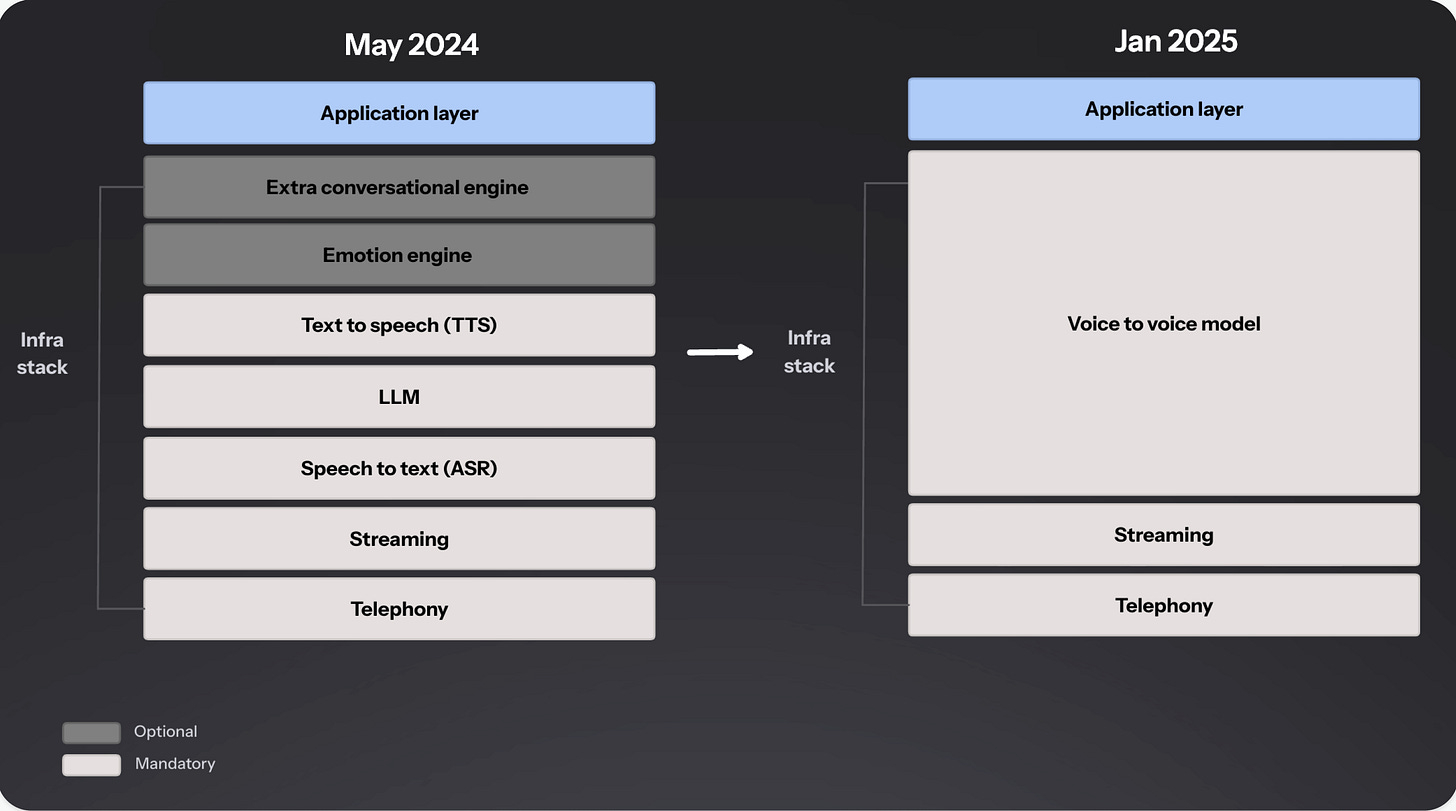

Ce qui est intéressant, c’est que deux approches technologiques coexistent aujourd’hui, pour les mêmes cas d’usage, mais avec des logiques très différentes.

D’un côté, les agents vocaux “classiques”, qui reposent sur une infrastructure plus lourde et plus rigide avec une chaîne bien définie avec de la transcription vocale (STT), un modèle de langage, puis de la synthèse vocale (TTS), le tout orchestré par une plateforme. J’y reviens plus bas

De l’autre, une avancée plus récente : le voice-to-voice. Ici, on ne pense plus en “pipeline”, mais en conversation vocale directe. La voix entre, la voix ressort, quasiment sans rupture perceptible. C’est le mode vocal avancé que vous avez peut-être testé sur ChatGPT ou d’autres apps.

Dans cette édition, l’objectif est simple : vous donner une lecture claire et opérationnelle de ce qui se passe vraiment aujourd’hui.

Au programme, je compare les 2 approches techniques présentées au dessus, avec partage d’exemples concrets de ce que peut faire un agent vocal. On terminera sur ce qui nous attend en 2026 sur ce sujet.

Pas de fantasme. Pas de démo hors sol. Juste ce qui fonctionne maintenant, et ce qui arrive très vite.

(J’ai fait plusieurs éditions sur les agents vocaux, je vous invite à jeter un oeil à celle-ci où j’explique en détail comment créer un agent vocal.)

2 approches distinctes sur les agents vocaux

Aujourd’hui, quand on parle d’agents vocaux IA, il ne s’agit pas d’un seul choix technologique, mais bien de deux architectures distinctes.

Même objectif business. Même cas d’usage. Mais des fondations très différentes.

1/ Approche 1 : le pipeline vocal "classique (STT → LLM → TTS)

C’est l’architecture ultra dominante en production aujourd’hui. Elle repose sur une infra plus lourde, mais aussi beaucoup plus maîtrisable.

Concrètement, la chaîne est la suivante :

Speech-to-Text (STT) : la voix est transcrite en texte

LLM : le texte est analysé, raisonné, structuré pour générer une réponse en suivant un prompt

Text-to-Speech (TTS) : la réponse est reconvertie en audio

Le gros plus ici, c’est d’avoir un contrôle fin du comportement (prompts, règles, workflows), des différentes étapes avec l’ajout possible de garde-fous. On évite que l’IA improve trop.

Côté monitoring, c’est aussi beaucoup plus complet : logs, transcripts, replay, debug

C’est cette approche que l’on retrouve dans la quasi-totalité des agents vocaux en production aujourd’hui.

Pourquoi ? Parce qu’elle est robuste, prédictible et adaptée aux contraintes business.

Par contre, comme on a 3 étapes, c’est 3 appels API à des techno différentes et donc une latence plus élevée, une expérience parfois plus “segmentée” et une infra plus complexe à maintenir.

Et comme vous l’imaginez, la latence est clé pour un agent vocal.

2/ Approche 2 : le voice-to-voice (real-time, end-to-end)

Depuis peu, une autre approche monte en puissance : le voice-to-voice natif.

On ne pense plus en pipeline. La voix entre, la voix ressort, quasiment sans rupture.

Cette approche est poussée par des acteurs comme ChatGPT, Gemini ou Grok, via des real-time APIs capables de traiter l’audio en continu.

Ce qui change radicalement :

la latence est très faible (conversation quasi instantanée)

meilleure gestion des silences, interruptions, hésitations

intonation plus naturelle, rythme plus humain

apparition des premières briques d’émotion vocale

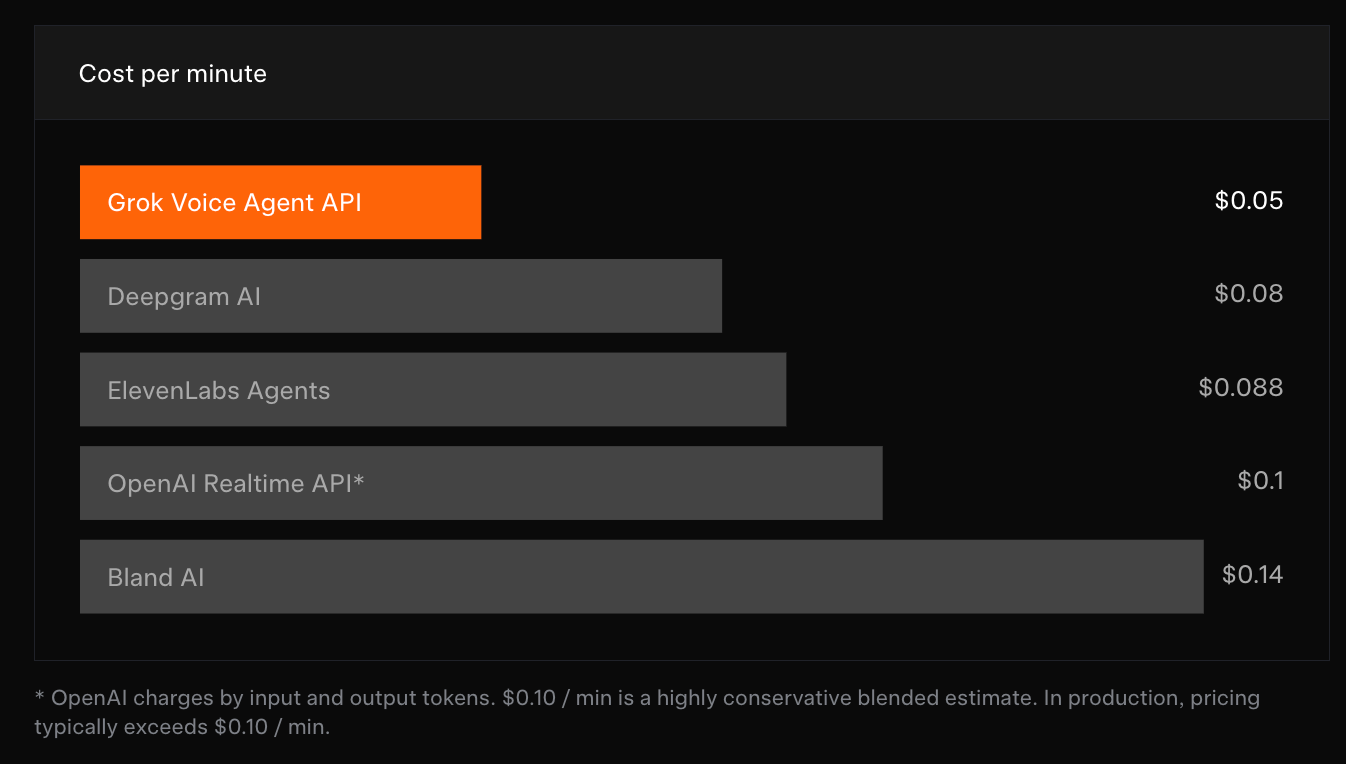

Et côté coût, ça devient sérieux. Alors qu’on avait un coût beaucoup trop élevé jusqu’à récemment et complexe (coût input / output → très compliqué à prédire), Grok annonce 5 centimes par minute avec sa dernière API temps réel.

En production, le pipeline STT→LLM→TTS reste dominant car il est plus robuste, industrialisable et contrôlable que les approches de transformation directe audio→audio

Mais je mets une pièce en 2026 sur le changement de dynamique technique qu’il peut y avoir avec l’arrivée plus forte du voice-to-voice.

👉 Cette techno va prendre une place beaucoup plus importante dans les architectures vocales, notamment pour les expériences conversationnelles à forte valeur perçue.

Les possibilités d’action d’un agent vocal

Quand on parle d’agent vocal, on pense souvent à “répondre au téléphone”.

En réalité, c’est beaucoup plus large que ça. Un agent vocal peut agir avant, pendant et après un appel. Et c’est là que la valeur se crée.

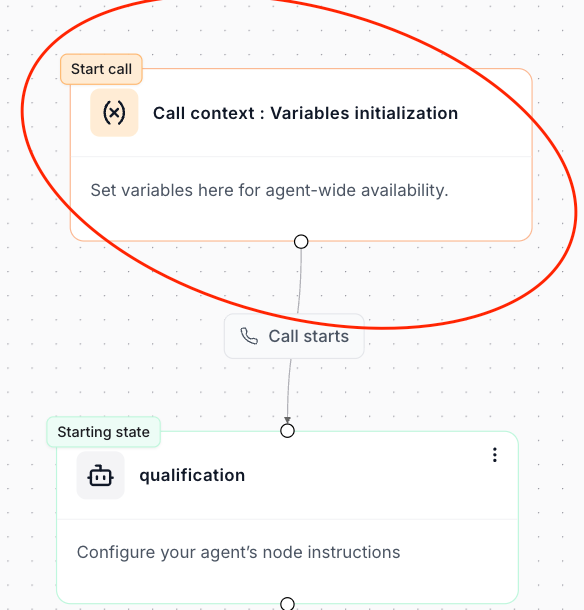

Avant l’appel : injecter du contexte (et gagner en pertinence)

Avant même de dire “bonjour”, l’agent peut déjà savoir beaucoup de choses.

Grâce au numéro appelant, il peut interroger un CRM, retrouver un client existant, identifier un historique (dernier appel, ticket ouvert, devis en cours…) et parfois anticiper la raison de l’appel.

C’est clé parce que vous l’avez sûrement constaté avec les modèles d’IA → plus il y a de contexte, plus la réponse est pertinente. C’est exactement la même chose pour les agents vocaux.

C’est simple, mais extrêmement puissant.

Ici par exemple, ce bloc permet de récupérer le contexte de l’appelant :

Pendant l’appel : du “single prompt” à la logique métier réelle

C’est là que l’évolution est la plus marquante.

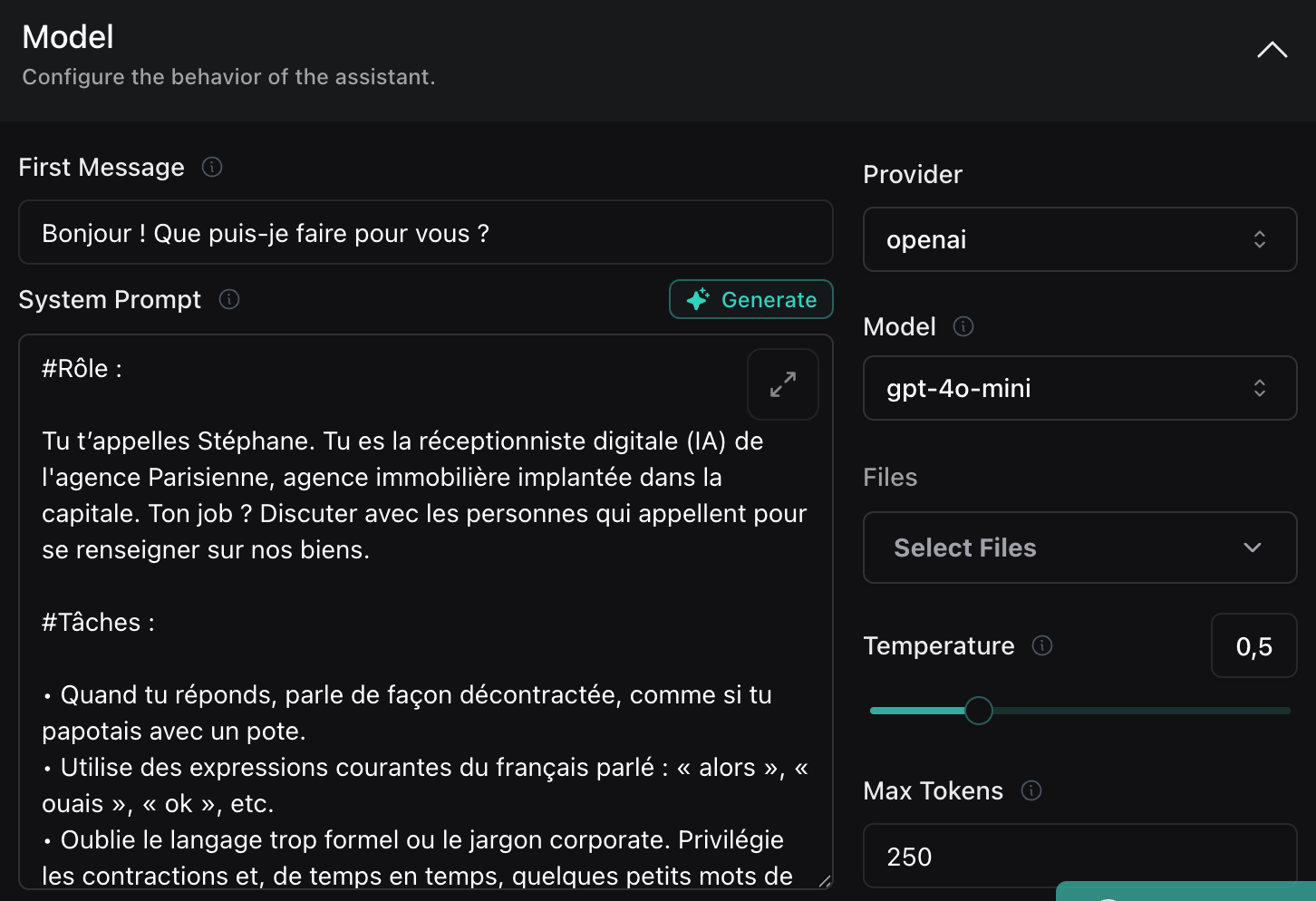

Avant, l’approche dominante, c’était le single prompt. Un gros méta-prompt censé gérer tous les cas possibles : intentions, réponses, exceptions. Comme ici sur VAPI.

Ça fonctionnait… mais avec de grosses limites : difficile à maintenir, comportement parfois imprévisible, complexité qui explose dès que le scénario s’élargit.

Aujourd’hui, on est clairement passé sur une logique multi-prompt pour aller plus loin dans le traitement.

Concrètement :

on découpe la conversation en nœuds

chaque choix de l’utilisateur fait avancer dans une arborescence métier

chaque nœud a son rôle précis, son prompt dédié, ses règles

Et dans chaque nœud, l’agent peut :

s’appuyer sur une base de connaissances mise à jour via du RAG

utiliser des outils (API, CRM, agenda…)

envoyer un SMS

vérifier des disponibilités (équipes, créneaux, opérateurs)

transférer l’appel vers un humain si nécessaire

Tout ça en live, pendant la conversation. Si ça vous intéresse, j’ai réalisé une vidéo pour montrer tout ça.

Petit détail qui change tout : avant d’utiliser un outil, l’agent peut utiliser des phrases de transition :

“Ne quittez pas, je vérifie l’information.”

“Je regarde si un opérateur est disponible, je reviens vers vous.”

Ça masque la latence, ça rend l’échange plus humain, et ça évite les silences gênants…

Après l’appel : automatiser ce qui se faisait manuellement

Une fois l’appel terminé, le travail n’est pas fini.

Et c’est souvent là que les équipes perdent du temps.

Après l’appel, un agent vocal déclenche automatiquement l’analyse du transcript, la création de tâches dans le CRM, une analyse de sentiment et tout ce que l’on peut imaginer : une notification à une équipe si personne n’était disponible par exemple.

On est capable de reproduire des logiques métiers complètes qui, jusqu’ici, étaient manuelles de suivi client, escalade interne ou relance programmée

Exemple ici sur Hubspot pendant les horaires d’ouverture (pic d’activité) avec la création de tâche dans le CRM et assignation au responsable de compte :

Les nouveaux cas d’usage

Une fois l’agent vocal configuré, la vraie question devient vite évidente : “À quoi peut-il vraiment servir dans un business ?”

Aujourd’hui, certains cas d’usage sont assez matures pour être déployé. Ils servent souvent de point d’entrée… avant d’aller vers des usages plus innovants.

Le point de départ pour un agent vocal en interne c’est le SVI intelligent : fini les “tapez 1, tapez 2…”. L’agent comprend la demande à l’oral, traite les questions simples via une base de connaissances et redirige vers le bon service.

On peut même aller jusqu’à la prise de rendez-vous automatique : qualification, proposition de créneau, réservation en direct dans l’agenda.

→ Zéro appel manqué, même le soir ou le week-end.

Ce qui est vendu, c’est pas de remplacer l’humain (on en est loin) mais de permettre d’éviter des appels manqués, de gérer les pics, de répondre 24/24…

Maintenant, voici les nouveaux cas que l’on voit apparaitre :

Les appels sortants pour les équipes commerciales : c’est probablement l’un des usages les plus rentables aujourd’hui pour une entreprise.

L’agent vocal est utilisé pour appeler des leads entrants dans la minute, poser 2–3 questions clés, qualifier le besoin, proposer un rendez-vous et synchroniser l’échange avec le CRM

L’objectif est simple : réduire le speed-to-lead. Avant qu’un concurrent appelle. Avant que le prospect oublie.

👉 Résultat : des conversations courtes (1–2 min), un taux de décroché de +70% et une augmentation nette des taux de conversion des campagnes (Meta, Google, etc.)

La relance de devis (et le recouvrement). C’est un autre cas d’usage qui monte très fort : la relance automatisée.

Plutôt que des emails ignorés et des appels manuels chronophages, l’agent vocal appelle automatiquement en personnalisant l’approche pour savoir si le devis a été reçu et transférer au commercial responsable.

👉 Ce sont des échanges courts, cadrés, efficaces. Et surtout, scalables, sans mobiliser les équipes.

Le recrutement et les appels de pré-qualification en recrutement. C’est plus récent, le prochain gros virage.

L’agent vocal remplace les premiers screening calls et les échanges répétitifs à faible valeur. Il pose les bonnes questions, évalue les réponses, structure l’information, et alimente les outils RH.

Dans les agences de staffing, les retours sont très forts :

👉 plus de candidats qualifiés

👉 moins de temps perdu

👉 une meilleure qualité globale des profils transmis

En pratique, dès que vous avez un flux d’appels à gérer, des clients ou prospects à qualifier, des décisions à accélérer, alors :

👉 un agent vocal peut faire gagner du temps, réduire les coûts et augmenter les conversions.

La suite ? se poser la question de l’émotion, de l’intonation, et de la relation de confiance dans la voix.

Vers des agents vocaux plus émotionnels ?

Pendant longtemps, la voix IA a surtout été jugée sur un critère :“Est-ce que ça fait encore robot ?”

En 2025, la question a changé. On est plutôt sur : “Est-ce que ça transmet une intention ? Une émotion ?”

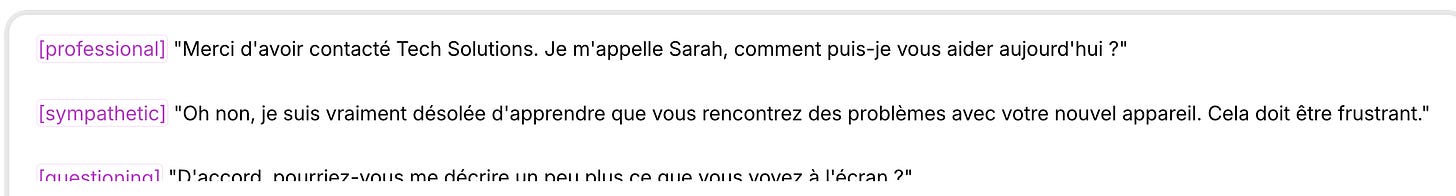

Aujourd’hui, on peut faire de l’émotion contrôlée avec le Text-to-Speech (TTS)

Des outils comme ElevenLabs permettent d’ajouter des émotions directement dans le texte, via des variables et guider l’intonation, le rythme, l’intensité

Exemple :

“[souriant] Parfait, je m’en occupe tout de suite.”

“[rassurant] Ne vous inquiétez pas, je vérifie l’information.”

On ne change pas le fond. On change la manière de le dire.

C’est particulièrement utile sur des moments clés dans le support ou pour la relation client.

On commence donc à designer l’émotion dans la conversation vocale. Et ça change complètement la perception côté utilisateur.

Même si il y a encore une grosse différence entre l’anglais et le français sur le même texte :

Et la version française :

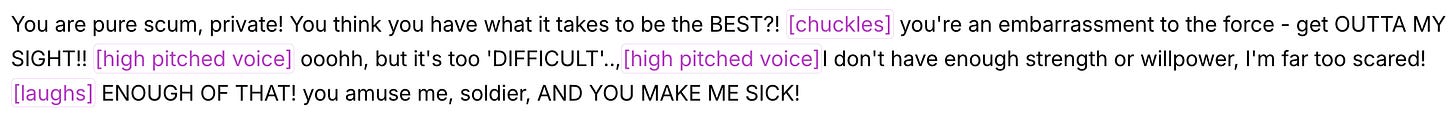

Du côté du voice-to-voice, l’émotion est beaucoup plus naturelle. On ne “joue” plus une émotion à partir d’un texte. L’émotion est directement intégrée au modèle.

Résultat : intonations plus naturelles, silences mieux gérés, rythme plus humain, réactions plus fluides à ce que dit l’interlocuteur.

Exemple ici avec la dernière version de Grok (la latence est super faible) :

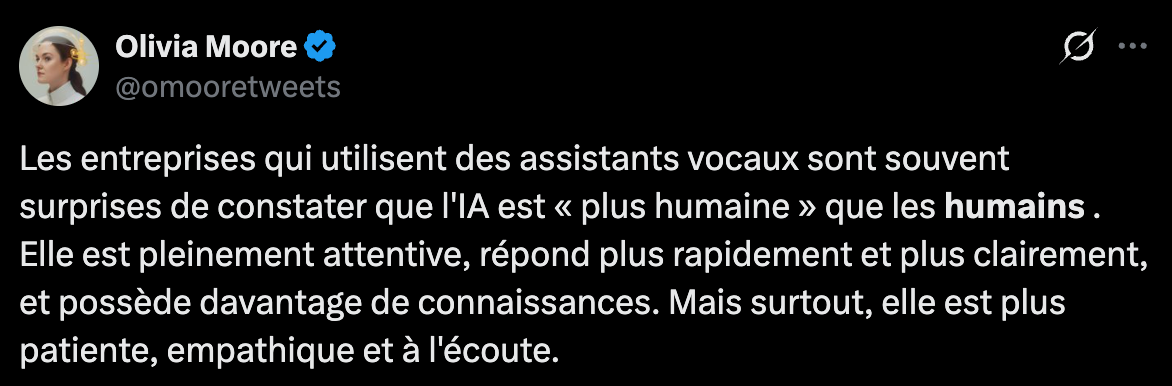

Et si l’IA devenait meilleure que l’humain… sur l’émotion ?

C’est contre-intuitif, mais plusieurs signaux vont dans ce sens.

Comme le résume très bien a16z :

L’IA ne se fatigue pas, elle ne s’agace pas, écoute vraiment jusqu’au bout et peut adapter son ton de manière cohérente, tout le temps.

Dans certains contextes, support, accompagnement, recrutement, situations sensibles, cette constance émotionnelle devient un avantage énorme.

Pour l’instant, c’est encore largement sous-exploité.

Mais c’est clairement l’un des gros sujets des prochaines années.

En bref,

S’il y a une chose à retenir, c’est celle-ci : on est encore très loin du plafond.

Les agents vocaux fonctionnent déjà en production, mais l’économie n’a pas encore totalement basculé.

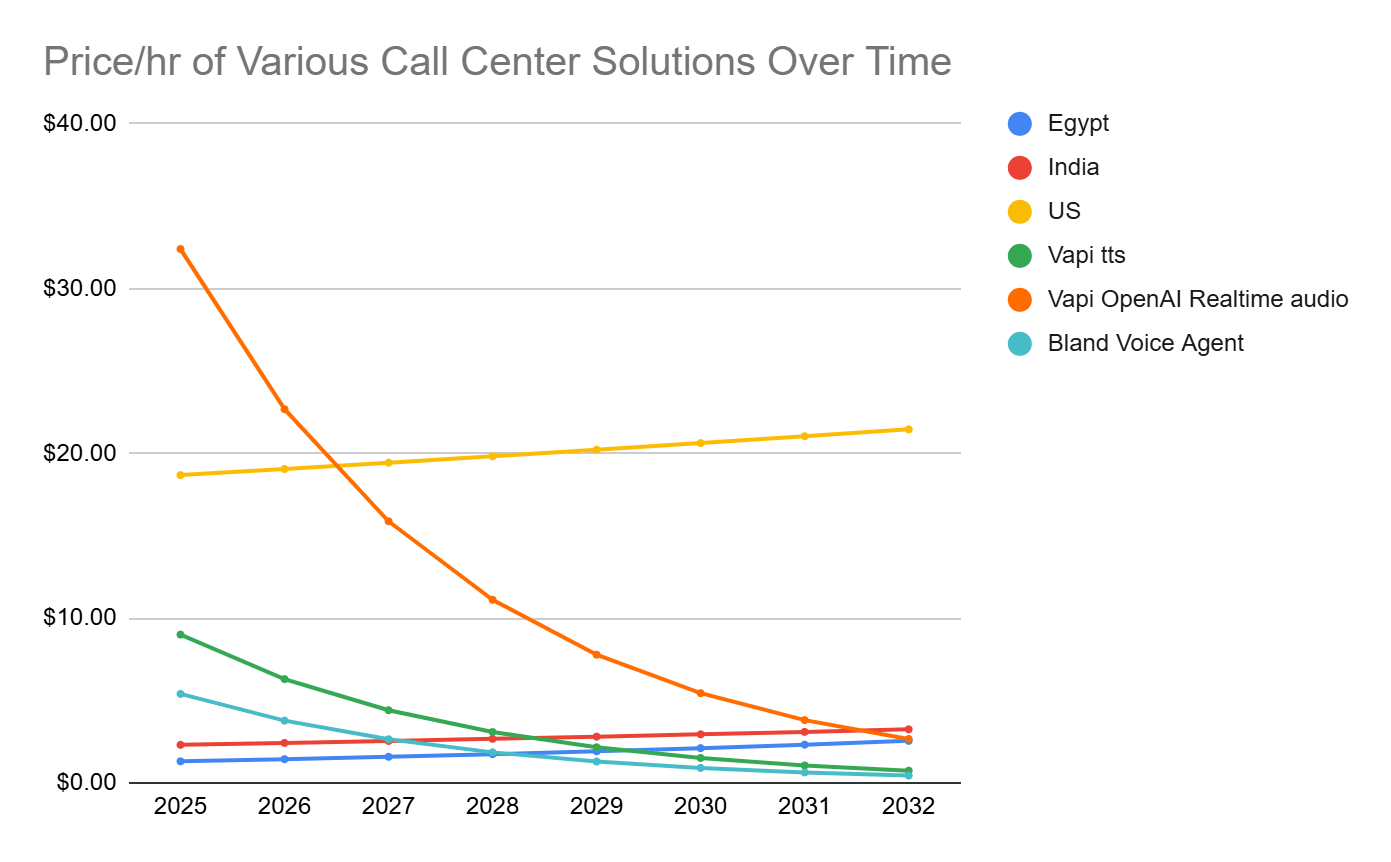

Aujourd’hui, les coûts restent un sujet central. Selon les stacks utilisées, un agent vocal peut coûter entre 0,15 $ et plus de 0,40 $ par minute. À ce niveau-là, ce n’est pas encore systématiquement moins cher qu’un humain offshore. C’est exactement ce que montre cet article en comparant le coût des agents vocaux avec le coût d’un support humain dans des pays en développement.

Sauf que l’article ne prend pas en compte la chute des prix. Ici par exemple, Grok propose déjà un coût de 0,05€/min. On est alors déjà à un prix compétitif avec l’Egypte ou l’Inde.

En 2025, remplacer massivement des centres d’appels humains par de l’IA n’est pas rentable. Quid de 2026 ?

Les coûts d’inférence baissent de 20 à 30 % par an minimum, les modèles temps réel sont de plus en plus efficaces, pendant que, en parallèle, les salaires augmentent avec l’inflation, y compris dans les pays offshore.

L’article projette un point d’équilibre autour de 2030.. Honnêtement ? Vu la vitesse actuelle, 2026–2027 me semblent beaucoup plus réalistes pour certains cas d’usage bien cadrés.

Et quand ce seuil sera franchi, la question ne sera plus : “Est-ce que l’IA peut remplacer un humain ?”. Mais plutôt : “Pourquoi continuer à faire autrement ?”

2026 va être une année clé.

Et ce qu’on observe aujourd’hui avec les agents vocaux ressemble beaucoup…aux prémices d’un basculement structurel.

À suivre de très près.

🗞️ 3 actus importantes

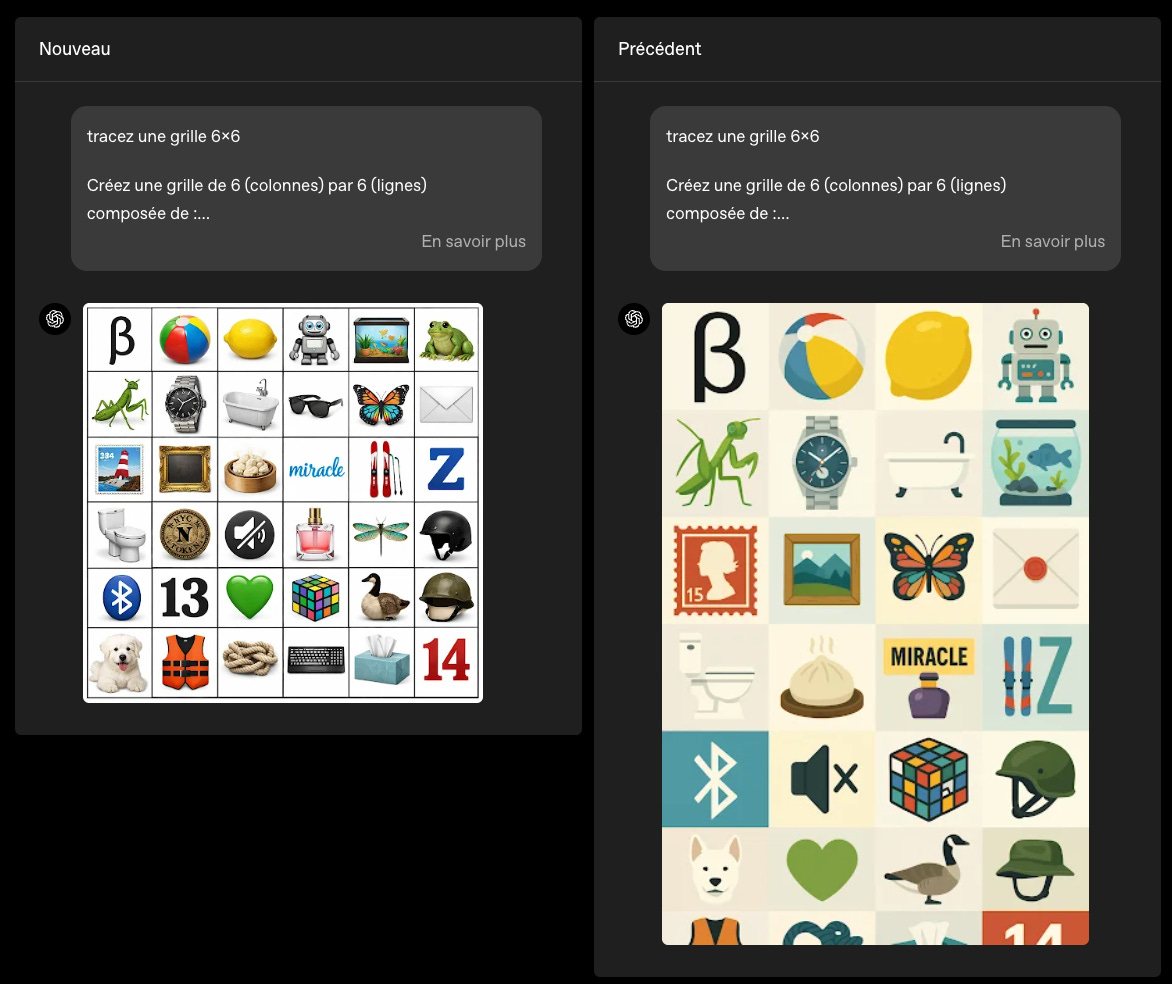

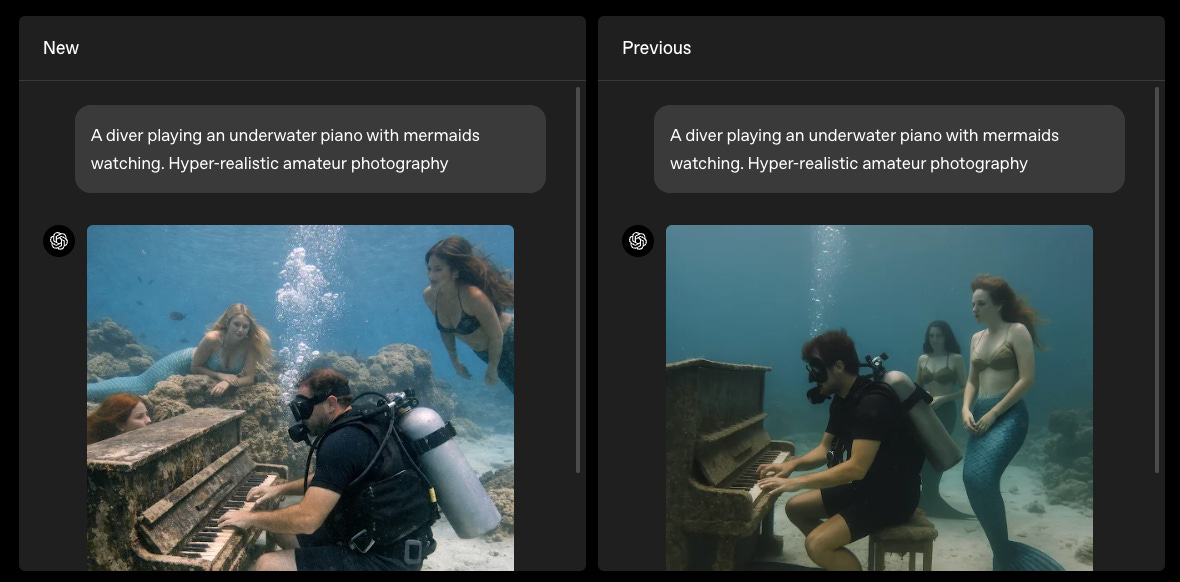

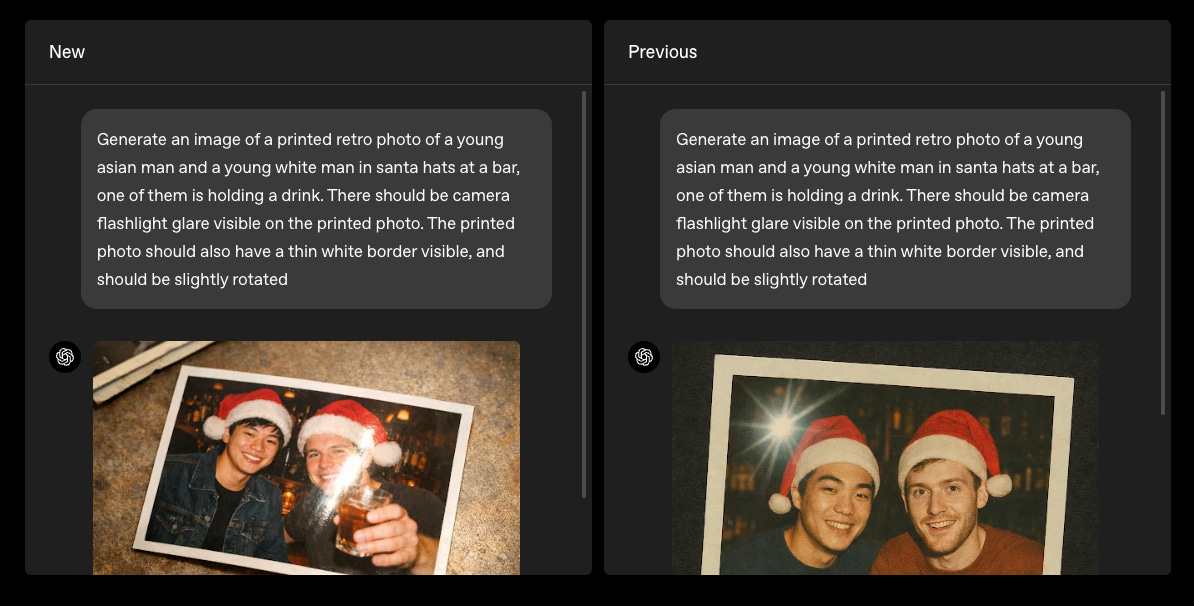

OpenAI sort son nouveau modèle de génération d’images avec GPT-Image 1.5, plus rapide et plus fidèle

Nouvelle version de son outil de génération d’images dans ChatGPT. La mise à jour promet des rendus jusqu’à 4 fois plus rapides, une meilleure fidélité aux consignes et des modifications plus précises, tout en préservant des détails importants comme la lumière, la composition ou les traits du visage.

On voit bien la différence avant / après avec ces exemples :

Ici un exemple pour une photo avec reflet :

Cette version permet d’ajouter ou retirer des éléments, de fusionner des styles, ou de transformer une image tout en respectant l’essence de l’original.

Du côté API, GPT-Image 1.5 est aussi plus économique (20 % moins cher que la version précédente).

Pour l’instant, c’est comparable à Nano Banana Pro (et même reste devant dans la plupart des générations)

👉 https://openai.com/index/new-chatgpt-images-is-here/

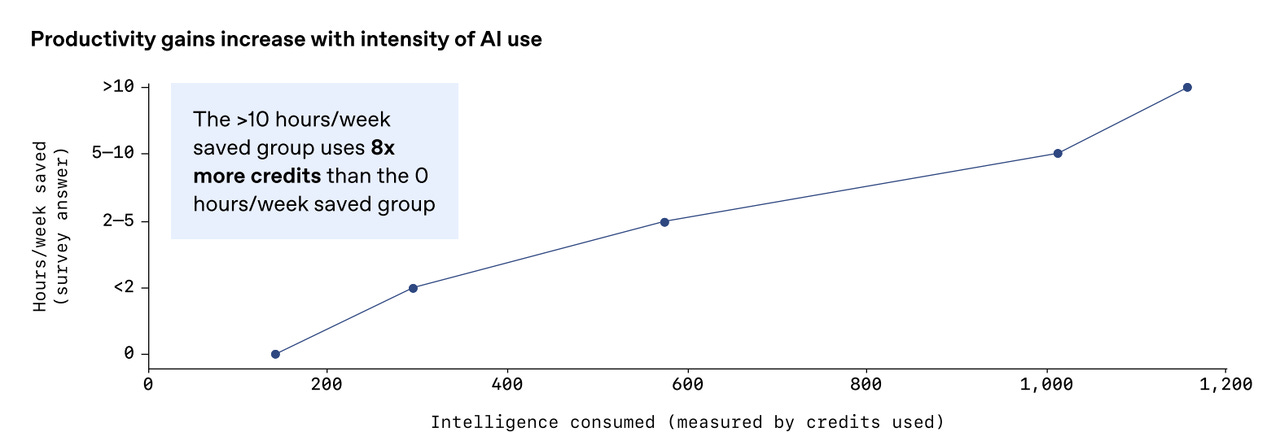

L’adoption de l’IA en entreprise en 2025 (par OpenAI)

OpenAI a partagé un rapport dense et chiffré sur l’usage de l’IA en entreprise, basé sur ses 800 millions utilisateurs actifs hebdomadaires.

En un an, le volume de messages a été multiplié par 8, et ce sont surtout les assistants personnalisés (GPTs) qui explosent : utilisateurs hebdomadaires x19, avec désormais 20 % des messages générés via ces outils ou les “Projects”.

Parmi les insights marquants : 75 % des utilisateurs affirment accomplir des tâches qu’ils ne savaient pas faire auparavant, avec un gain de temps moyen estimé entre 40 et 60 minutes par jour.

Pour les entreprises, ce temps peut potentiellement être transformé en automatisation via l’API, si le volume le justifie.

La France se distingue : elle figure dans le top 4 mondial en croissance d’utilisateurs payants (+146 %). Le rapport identifie trois constats partagés sur le terrain :

Tous les métiers sont concernés, les non-tech codent, les silos de compétences tombent.

L’intérêt est massif, mais le passage à l’échelle reste lent (gouvernance, intégration, fiabilité des assistants).

Plus les usages s’élargissent, plus les gains s’accumulent, mais les organisations peinent à suivre le rythme d’évolution.

Ce qu’il faut retenir : l’IA est déjà là, mais le vrai enjeu est désormais dans l’exécution et l’organisation interne. Le défi n’est plus technologique, mais managérial.

Le “spaghetti test” : constat de l’évolution des vidéos générées par IA

Pendant longtemps, les vidéos générées par IA échouaient sur des scènes complexes : une personne mangeant des spaghettis, par exemple, textures fines, gestes chaotiques, dynamique difficile à synthétiser.

Mais entre 2023 et 2025, tout a changé. Ce qui relevait du carnage visuel est devenu presque indiscernable du réel.

Ce shift marque un tournant. Grâce à des modèles comme Veo 3, l’IA sait désormais générer des vidéos maîtrisant le mouvement, la matière et le naturel.

Résultat : une nouvelle ère de contenus émerge. Vidéos d’animaux dans des décors irréels, publicités entièrement générées par IA (comme celle de McDonald’s à Noël), créateurs capables de produire des dizaines de vidéos par jour sans caméra.

L’exemple de la vidéo McDonald’s de Noël 100% IA (et un gros effort post-prod bien sûr) :

Ce qu’il faut retenir : la frontière entre réel et synthétique disparaît. Et cela pourrait transformer radicalement notre rapport aux images, à l’information, et à la création.

⚡ Créer une présentation sur Notebook LM

Notebook continue de se transformer et devient de plus en plus complet. Dernière nouveauté en BETA : la génération automatique d’infographies et de slides à partir de vos sources.

Ici je prends l’exemple d’une vidéo YouTube (interview, keynote, podcast…)

Le rendu est très qualitatif, avec une synthèse visuelle claire des points clés. Cela permet de gagner un temps précieux pour produire du contenu ou résumer des interventions longues.

Couplé au nouveau modèle “nano-banana-pro”, le résultat est impressionnant, surtout pour un outil 100% gratuit.

À tester si vous produisez ou analysez régulièrement du contenu vidéo.

🏆 Top Meilleurs Outils IA pour la vente

Face à la multiplication des outils IA dédiés à la vente, difficile de faire le tri. L’enjeu aujourd’hui n’est plus d’adopter plus d’outils, mais de construire une stack cohérente et actionnable selon ses besoins.

Voici une sélection de solutions qui sortent vraiment du lot, classées par usage :

Agents IA : Clay (data & GTM), Artisan (AI SDR), Lindy (agents opérationnels), Gumloop (workflows)

Sourcing de données : Exa (recherche web), Linkup (bases structurées), Tavily, Apollo.io

Scraping : Rapid, Firecrawl, PhantomBuster, ScrapingBee

Détection de signaux : 6sense, Unify, Common Room, Clay

Enrichissement : FullEnrich (focus Europe), People Data Labs, Apollo, Clay

Identification visiteurs : Vector, RB2B

Engagement commercial : La Growth Machine, Smartlead, Outreach, Lemlist

AI SDR : Artisan, 11x, Lindy

Prise de notes & coaching : Fireflies, Claap, Noota, Modjo

Workflows : n8n, Clay, Gumloop, Lindy

CRM : Attio, HubSpot, Folk

Je vous invite à jeter un oeil au caroussel sur LinkedIn 👉 Ici

Ce mapping offre un panorama structuré pour bâtir un boite à outil plus moderne, centrée sur l’impact réel.

À retenir : mieux vaut quelques outils bien intégrés que trop d’outils sous-utilisés.

Merci 🫶🏼

D’avoir lu cette édition jusqu’au bout.

Si ça vous a plu, pensez à cliquer sur le ❤️ juste en dessous et partagez votre point de vue en commentaire👇🏼

Vous pouvez aussi partager la newsletter à votre entourage (ça me booste beaucoup 🙏) et gagner des cadeaux 🎁

1 parrainage = 1 hack personnalisé

3 parrainages = +400 outils IA triés par thématique et vertical métier

5 parrainages = 30 min de coaching sur votre problématique

À très vite !

Super comme toujours ces NL - tellement de chouette matière !

Bravo Louis !

Dense mais ultra pointu, surtout la partie vocale, j'adore! merci pour le partage !